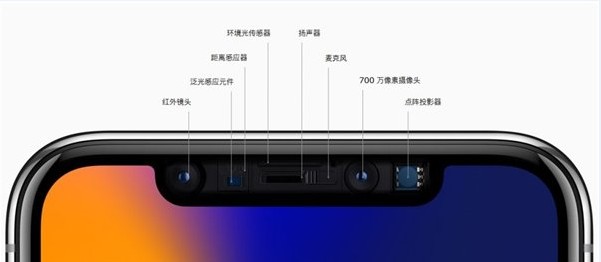

苹果最新发布的iPhone X旗舰手机中,最引人注目的功能之一就是3D感知功能,这一功能可以运用于AR增强现实增强现实体验,以及面容ID(Face ID)面部识别功能。其实很多年前,谷歌就发现了AR增强现实技术的潜力,因此2013年推出了谷歌眼镜,随后2014年又发布了面向智能手机的Project Tango项目。

因此,很多人认为,苹果可能从谷歌Project Tango那里抄袭了一些想法,因为市面上仅有的两款Project Tango智能手机中,所搭配的专业传感器中,就与iPhone X“刘海”那套原深感摄像头系统有相同类型的传感器。而且谷歌前不久发布ARCore的时候也表示,ARCore是三年前Tango移动AR技术的成果之一。

实际上,苹果针对3D感知技术的野心,远比谷歌Project Tango更早,或者说从5年之前苹果就已经计划好将3D感测技术运用到iPhone上了。

早在2013年11月份,苹果官方就证实了,公司已经收购了以色列以3D传感器技术为基础的初创公司PrimeSense。据当时的报道了解,苹果的收购价格为3.6亿美元,只不过在随后的监管申报文件中苹果并未披露官方数字。PrimeSense公司主要开发各种类型的3D传感器技术,虽然苹果公司迅速将PrimeSense此前官方相关业务资料从网络上移除了,包括官方的网站和大量宣传介绍视频,但PrimeSense一些旧概念视频仍然在一些网站上可以找到。

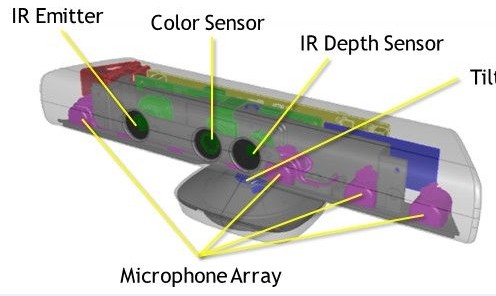

其实PrimeSense公司最被人所知的事件,还是因为帮助微软Xbox游戏机配件Kinect开发了3D感知传感器,基本上Kinect的多项技术都是基于PrimeSense技术参考设计打造的,包括提供的彩色摄像机和红外投影器等,这些传感器具有更高的精度和分辨率,可以帮助Kinect跟踪运动识别脸部,甚至可以探测玩家的心率。

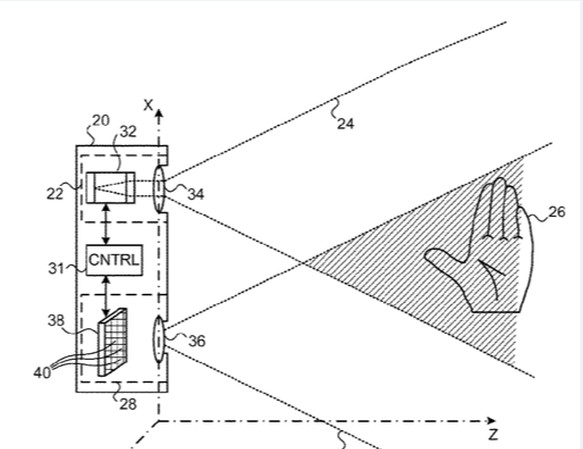

而Kinect这一套东西,又与iPhone X的原深感摄像头系统类似,只不过苹果利用PrimeSense获得的技术将其缩小尺寸塞进了iPhone X中。一些相关工作进程中,苹果还不断获批专利,例如2016年7月获批的结构化光投射专利,最初就是在2014年6月由PrimeSense工程师提交的。大约在一个月前,苹果还获得了一项涉及深度映射的有关专利,该专利最初也是在2013年2月由PrimeSense提交。

这就意味着,虽然苹果在2013年11月份才证实了这笔针对PrimeSense的收购,但是在更早之前苹果就已经开始考虑3D感知技术了,毕竟收购案通常需要一段时间才能完成。苹果必须先构思相关3D感知想法,接着评估发展空间,再寻找最好的技术及目标收购公司,然后接近目标收购的公司,谈判条款,执行尽职调查等等。而这些工作,起码在一年之前的2012年就已经展开,甚至更早。

苹果收购PrimeSense必然是希望将3D感知技术融入到iPhone当中。正如2012年苹果3.56亿美元收购AuthenTec时,大多数人就已经意识到苹果正在开发指纹识别iPhone。不出所料,苹果第二年发布的iPhone 5s就带来了Touch ID技术。那么面容ID为何要等到iPhone X?因为指纹识别技术主要是基于硬件的功能,而3D面部识别技术在硬件的基础上还包括主要的软件,需要更长时间开发。不过,苹果的等待可能也包括全面屏和A11的神经网络引擎。

所以,为什么说引入“面容ID”对于iPhone来说是一个里程碑,就是因为苹果其3D感测技术研发了5年左右的时间,直到现在才得到了想要的劳动成果。这也就意味着,如此复杂的3D感知技术对于竞争对手而言就是技术壁垒,至少在短时间内根本难以迅速做出来,而且即便做出来了也难以降低成本,或扩展到实际应用当中。

当然了,为了原深感摄像头和相应的软件技术,苹果收购的技术公司肯定不止PrimeSense一家,还包括有2015年收购的AR公司Metaio,专精于面部捕捉的FaceShift公司,以及去年收购的AI人工智能公司Emotient等等,太多人工智能和机器学习公司被苹果收入囊中。

总之,苹果的每一项运用到iPhone的技术都会规划很久,最近苹果硬件技术高级副总裁斯强尼·斯洛基证实了这一点,其中芯片的开发苹果会提前3年开始,也就是说3年前发布搭载A8芯片的iPhone 6时,苹果就已经在开发A11仿生芯片了。这一道理同样适用于研发了5年之久的原深感摄像头系统和AR技术。

究竟苹果还有哪些藏着的iPhone新技术,我们拭目以待。但话说回来,提前开发的先进技术,并不一定意味着这就是对的技术。